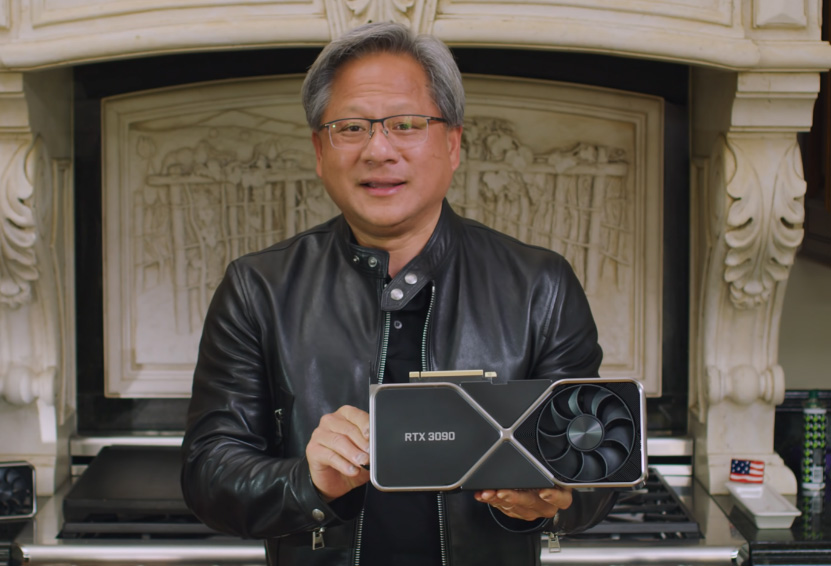

NVIDIA esitteli uudet GeForce RTX 30 -sarjan näytönohjaimet syyskuun alussa ja uusi lippulaivamalli on BFGPU-lempiniminen GeForce RTX 3090, jossa on käytössä enemmän CUDA-ytimiä, leveämpi muistiväylä ja enemmän näyttömuistia kuin RTX 3080:ssä. Hinta on 3080:een nähden kaksinkertainen ja kyseessä on edellisen sukupolven Titanin korvaaja.

GeForce RTX 3090 saapuu myyntiin tänään 24. syyskuuta ja sen suositushinta Yhdysvalloissa on 1499 dollaria ilman veroja. Suomessa yhtiön oman Founders Edition maksaa 1589 euroa ja näytönohjainvalmistajien mallit on hinnoiteltu jälleenmyyjillä 1590 ja 1859 euron välimaastoon.

Meille on tulossa io-techin testilaboratorioon NVIDIAn oma Founders Edition -malli, mutta valitettavasti se ei ehtinyt käsiimme julkaisupäiväksi. Tutustumme tässä artikkelissa GeForce RTX 3090 -näytönohjaimen ominaisuuksiin ja suorituskykytestit on ajettu 3840×2160-, 2560×1440- ja 1920×1080-resoluutioilla. Mukana on myös tehonkulutus-, lämpötila- ja melumittaukset sekä ylikellotustestit.

Tässä artikkelissa 3090-testitulokset on ajettu MSI:n GeForce RTX 3090 Gaming X Trio -mallilla, mutta testin eri näytönohjainvalmistajien GeForce RTX 3090 -malleista löydät täältä (Asus vs Gigabyte vs MSI):

- io-tech, Testissä GeForce RTX 3090 -näytönohjaimet (Asus, Gigabyte & MSI)

GeForce RTX 3080 vs 3090

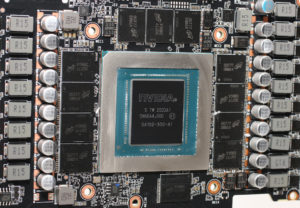

GeForce RTX 3090:ssä on käytössä lähes täysi GA102-grafiikkapiiri, josta on kytketty pois käytöstä ainoastaan yksi TPC ja kaksi SM-yksikköä eli 256 CUDA-ydintä, 8 teksturointiyksikköä, 8 tensoriydintä ja 2 RT-ydintä. GeForce RTX 3090:n GA102-300-grafiikkapiirissä on siis käytössä yhteensä 10496 CUDA-ydintä, 328 teksturointiyksikköä, 328 tensoriydintä, 82 RT-ydintä ja 116 ROP-yksikköä.

Samaa GA102-grafiikkapiiriä käyttävään RTX 3080:aan verrattuna 3090:ssä on CUDA-ytimiä käytössä 1792 enemmän, teksturointi- ja tensoriytimiä 56 enemmän (+21%), RT-ytimiä 14 enemmän ja ROP-yksiköitä 16 enemmän eli kaikkea 21 % enemmän.

Muistiväylä 3090:ssä on leveämpi eli 384-bittinen ja sen jatkeena on yli kaksinkertainen määrä eli 24 gigatavua 19,5 Gbps:n nopeudella toimivaa GDDR6X-muistia, jonka myötä muistikaistaa on käytettävissä 936 Gt/s eli 23 % enemmän.

Grafiikkapiirin Boost-taajuus on 3090:ssä 10 MHz alhaisempi kuin 3080:ssä eli 1700 MHz, mutta näytönohjaimen TDP-arvo on kasvanut 320 watista 350 wattiin.

GeForce RTX 3090 on varustettu NVLink SLI -liittimillä, mutta yhtiö on hiljattain ilmoittanut hautaavansa SLI-teknologian. NVIDIAn mukaan se lopettaa uusien SLI-profiilien julkaisun 1. tammikuuta 2021, jonka jälkeen yhtiö tulee keskittymään pelinkehittäjien avustamiseen multiGPU-tuen lisäämiseksi suoraan peleihin. Yhtiö tulee kuitenkin testaamaan jo olemassa olevien profiileiden toimintaa myös jatkossa. Ampere sukupolven ainut NVLink SLI -liittimillä varustettu näytönohjain GeForce RTX 3090 ei tule tukemaan SLI:tä erillisen profiilin vaativissa peleissä, vaan vain ”explicit multiGPU”-teknologiaa hyödyntäviä pelejä. NVIDIA tulee kuitenkin kutsumaan myös tätä useamman näytönohjaimen tukea SLI:ksi.

Testikokoonpano

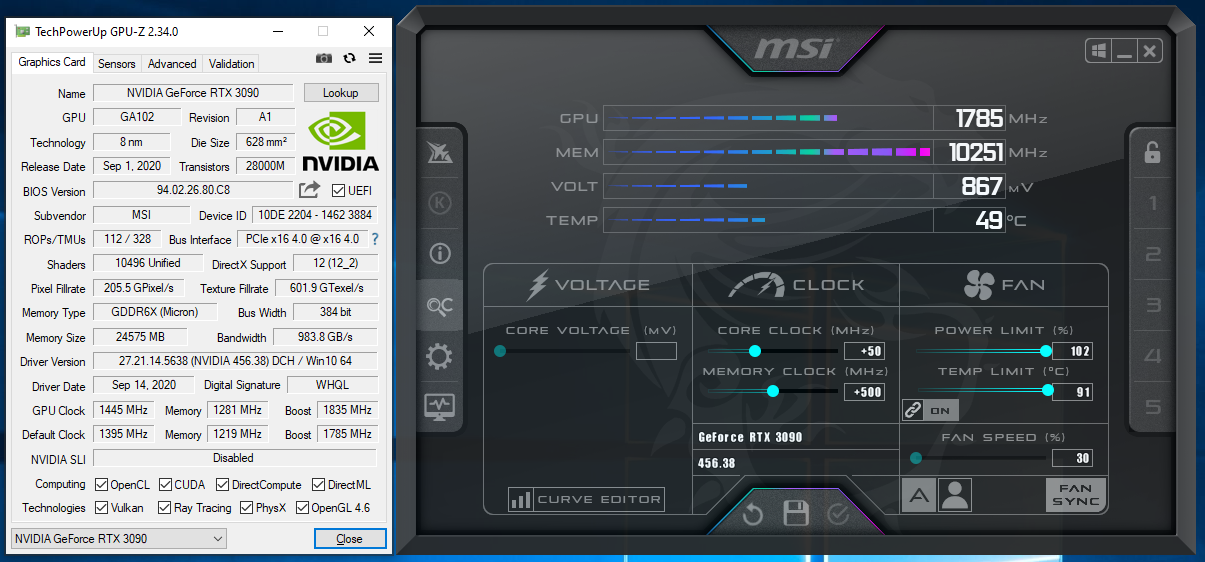

Suorituskykytesteissä 4k-resoluutiolla MSI:n GeForce RTX 3090 Gaming X Trio -näytönohjainta verrattiin ensisijaisesti yhtiön puolet halvempaan 3080 Gaming X Trio -malliin. Molemmat näytönohjaimet käyttävät samaa piirilevyä ja jäähdytysratkaisua. MSI on asettanut GeForce RTX 3090 Gaming X Trion grafiikkapiirin toimimaan 1785 MHz:n Boost-taajuudella ja todellinen kellotaajuus 3D-rasituksessa oli keskimäärin 1845 MHz.

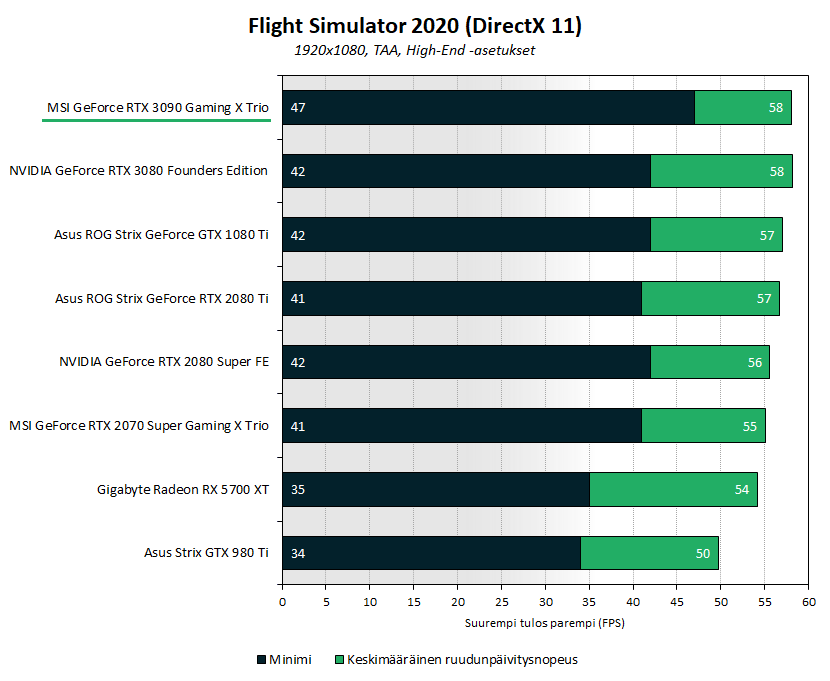

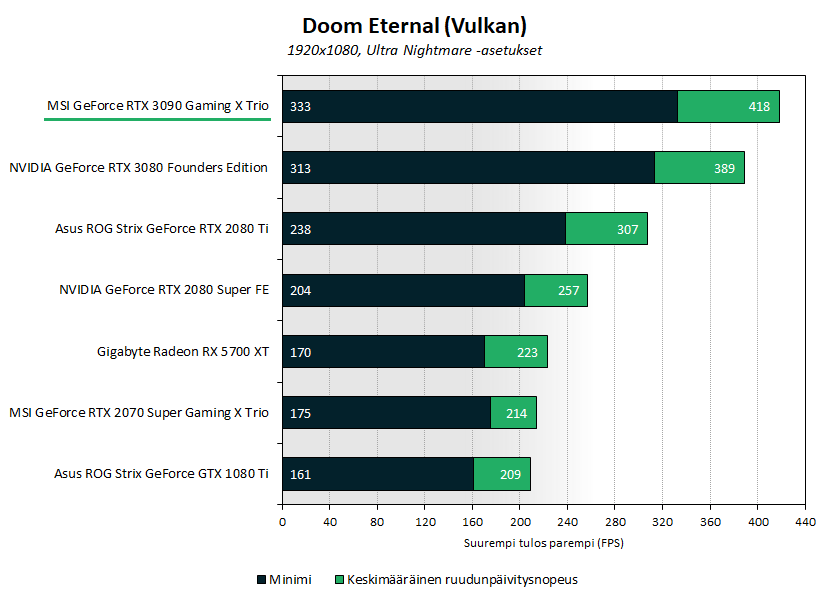

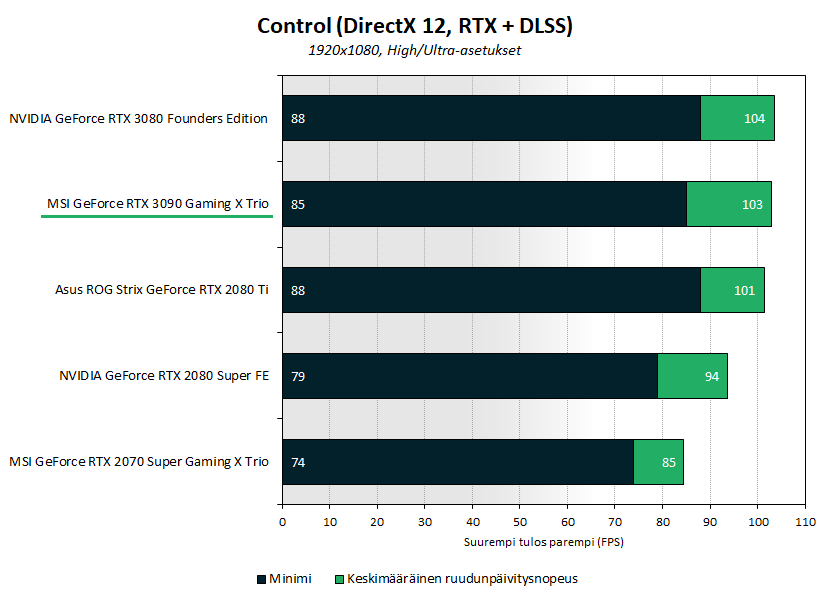

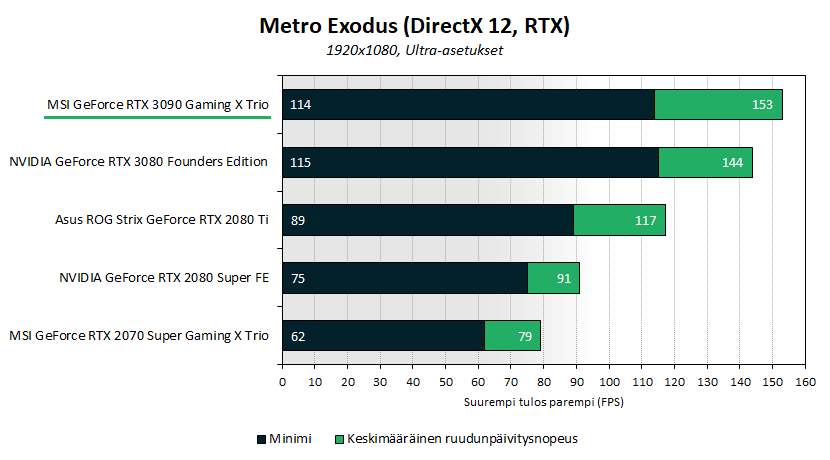

Vaikka 3090 on ehdottomasti suunnattu 4k-pelaamiseen, ajoimme artikkeliin testitulokset myös 1440p- ja Full HD -resoluutioilla, joissa 3090:n vertailukohtana on NVIDIAn oma 3080 Founders Edition -malli. Mukana on testitulokset myös edellisen sukupolven GeForce RTX 2080 Ti-, 2080 Super ja 2070 Super -malleilla sekä parin sukupolven takaisilla lippulaivamalleilla eli GeForce GTX 1080 Ti- ja GeForce GTX 980 Ti -näytönohjaimilla. AMD:n leiristä mukana on testitulokset Radeon RX 5700 XT:llä.

Hintataso Suomessa 24.9.2020

- GeForce GTX 980 Ti: käytettynä n. 150€?

- GeForce GTX 1080 Ti: käytettynä n. 300€?

- Radeon RX 5700 XT: alkaen 400 €

- GeForce RTX 2070 Super: alkaen 505 €

- GeForce RTX 2080 Super: alkaen 630 €

- GeForce RTX 3080: alkaen 739 €

- GeForce RTX 2080 Ti: alkaen 990 €

- GeForce RTX 3090: alkaen 1589 €

Näytönohjainten testikokoonpano on kasattu Cooler Masterin Cosmos C700P -kotelon sisälle, jonka etupaneelissa kaksi 140 mm:n kotelotuuletinta imee viileää ilmaa kotelon sisuksiin ja takapaneelissa yksi 140 mm:n tuuletin puhaltaa lämmintä ilmaa ulos. Testikokoonpanona toimi NZXT:n Kraken Z63 AIO -nestekierrolla jäähdytetty AMD:n 12-ytiminen Ryzen 9 3900XT -prosessori asennettuna Asuksen ROG Crosshair VII Hero -emolevylle ja 16 gigatavua DDR4-3600-nopeudella toimivaa keskusmuistia. Käyttöjärjestelmänä on käytössä 64-bittinen Windows 10 Pro asennettuna Corsairin 2 teratavun MP600 M.2 SSD:lle. Kokoonpanon virransyötöstä vastaa Corsairin 1000 watin HX-virtalähde.

- AMD Ryzen 9 3900XT (12/24 ydintä/säiettä, boost 4,7 GHz)

- Asus ROG Crosshair VIII Hero Wi-Fi (AMD X570)

- 32 Gt Corsair Dominator Platinum RGB 3600 MHz (16-18-18-36)

- Corsair MP600 2 Tt M.2 SSD (PCI Express 4.0)

- Cooler Master COSMOS C700P -kotelo

- NZXT Kraken Z63 AIO -nestekierto

- Corsair HX1000 (1000W)

- Microsoft Windows 10 Pro 64-bit

Näytönohjainten testimetodit

io-techin näytönohjaintesteissä suorituskykyä mitataan pelaamalla peliä 60 sekunnin ajan ja OCAT-sovelluksen avulla mitataan keskimääräinen ruudunpäivitysnopeus ja minimi, kun 1 % huonoimpia ruutuja jätetään huomioimatta. Kyseessä on tarkemmin ottaen 1. persentiili, kun ruutujen renderöintiajat on muutettu ruudunpäivitysnopeudeksi eli ruutua sekunnissa (FPS, Frame Per Second) ja järjestetty paremmuusjärjestykseen. Tavoitteena on jättää huomioimatta muutama yksittäinen muita hitaammin renderöity ruutu, joka on mahdollisesti poikkeustapaus.

Suorituskykytestit 3840×2160-resoluutiolla

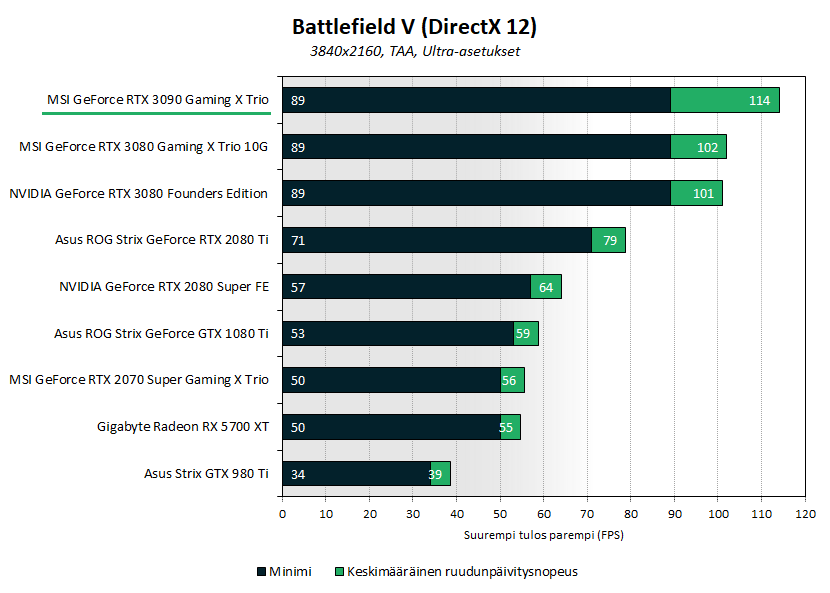

Battlefield V:ssä 4k-resoluutiolla MSI:n GeForce RTX 3090 oli 12 % suorituskykyisempi kuin MSI:n 3080 ja 44 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

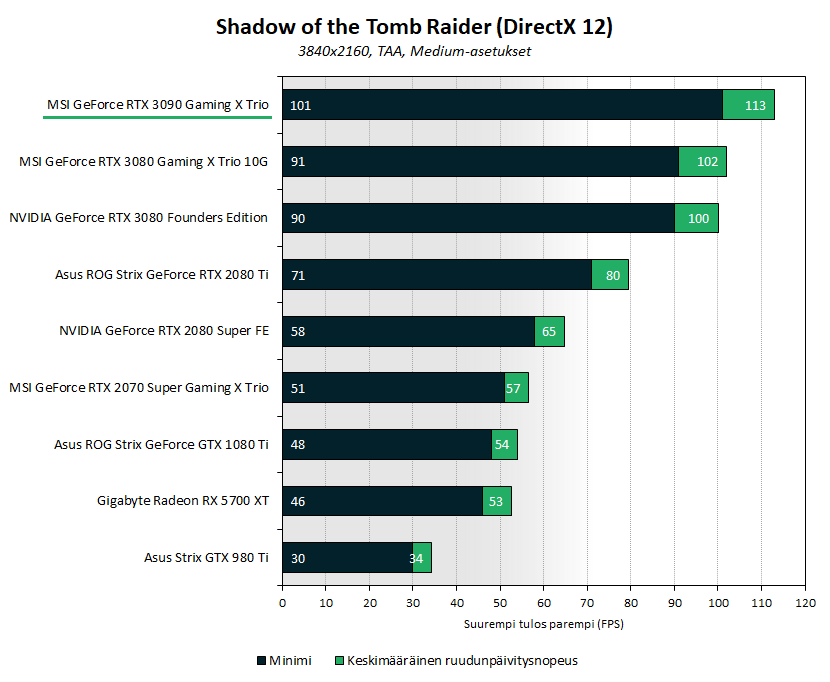

Shadow of the Tomb Raiderissa 4k-resoluutiolla MSI:n GeForce RTX 3090 oli 11 % suorituskykyisempi kuin MSI:n 3080 ja 41 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

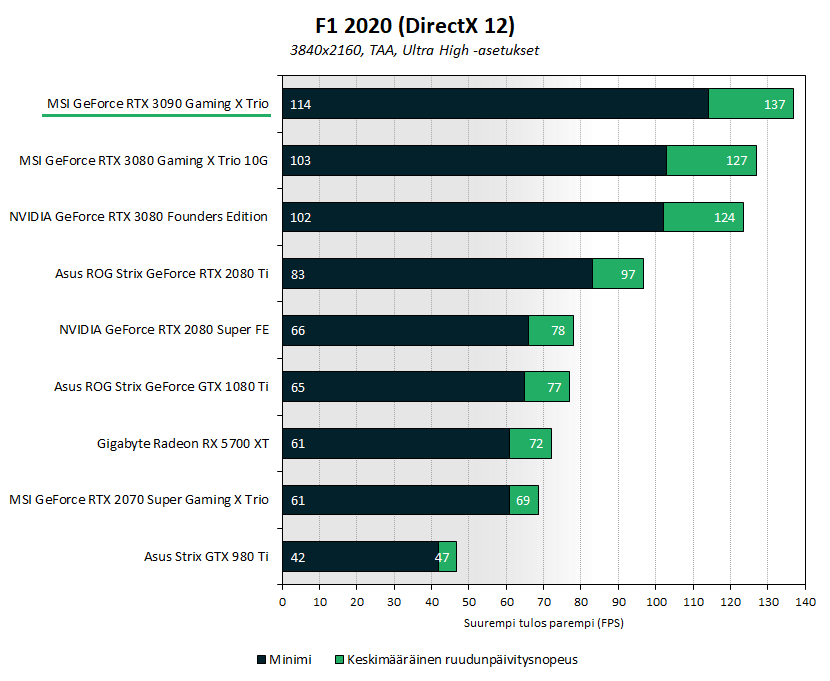

F1 2020:ssä 4k-resoluutiolla MSI:n GeForce RTX 3090 oli 8 % suorituskykyisempi kuin MSI:n 3080 ja 41 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

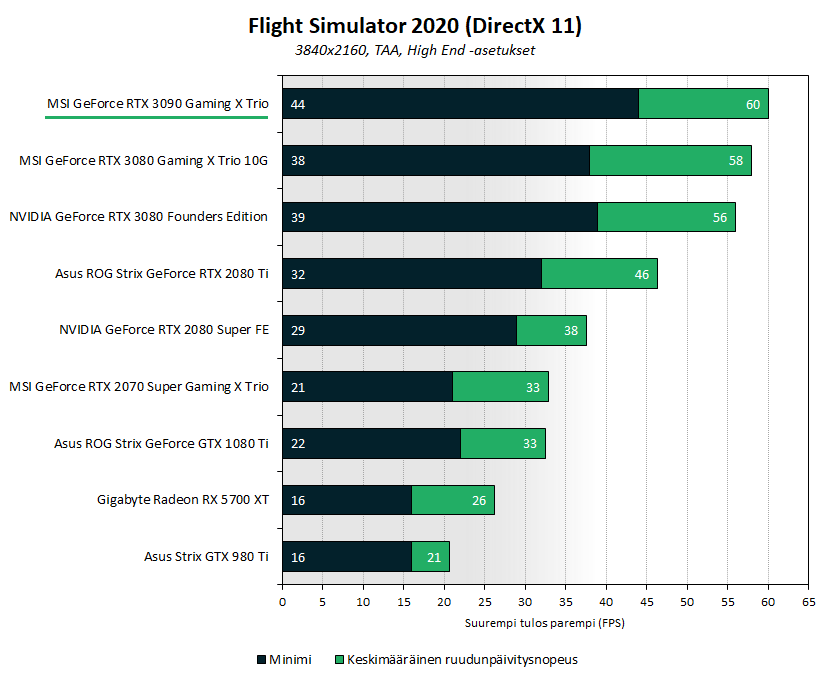

Flight Simulator 2020 testattiin High End -asetuksilla, sillä Ultra-asetuksilla näytönohjainten välille ei syntynyt eroja juuri lainkaan. Näytönohjaimen sijaan pelissä on varsinkin alhaisemmilla resoluutioilla pullonkaulana muu tietokone. 4k-resoluutiolla MSI:n GeForce RTX 3090 oli 3,5 % suorituskykyisempi kuin MSI:n 3080 ja 30 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

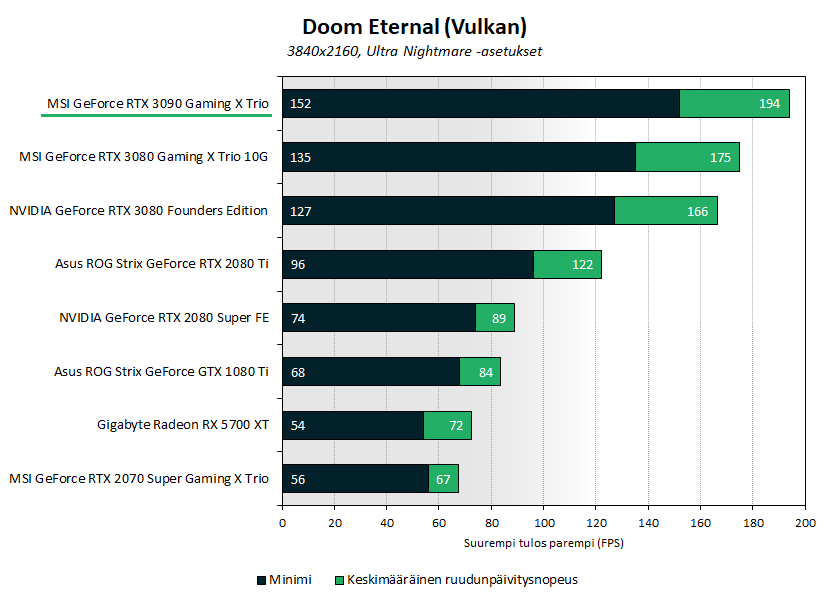

Doom Eternalissa 4k-resoluutiolla MSI:n GeForce RTX 3090 oli 11 % suorituskykyisempi kuin MSI:n 3080 ja 59 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

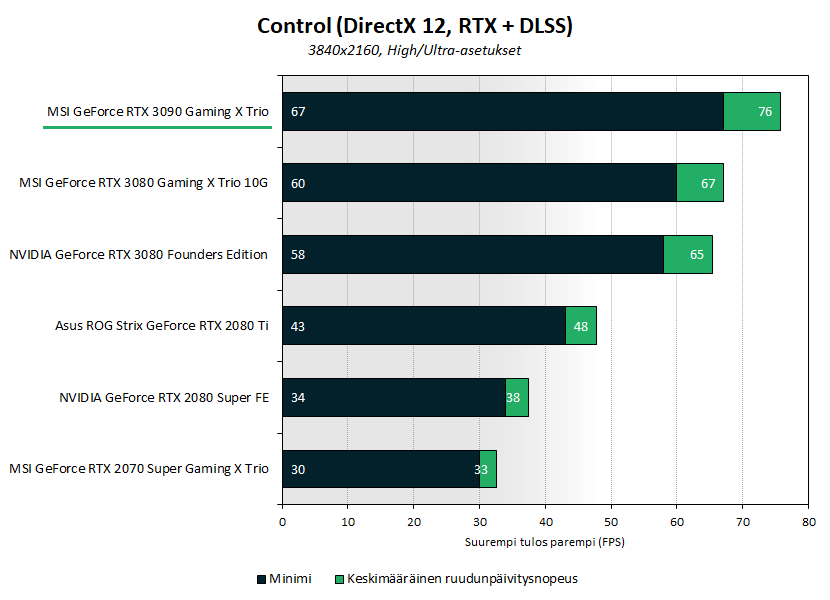

Controlissa RTX-säteenseuranta ja DLSS päällä 4k-resoluutiolla MSI:n GeForce RTX 3090 oli 13 % suorituskykyisempi kuin MSI:n 3080 ja 58 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

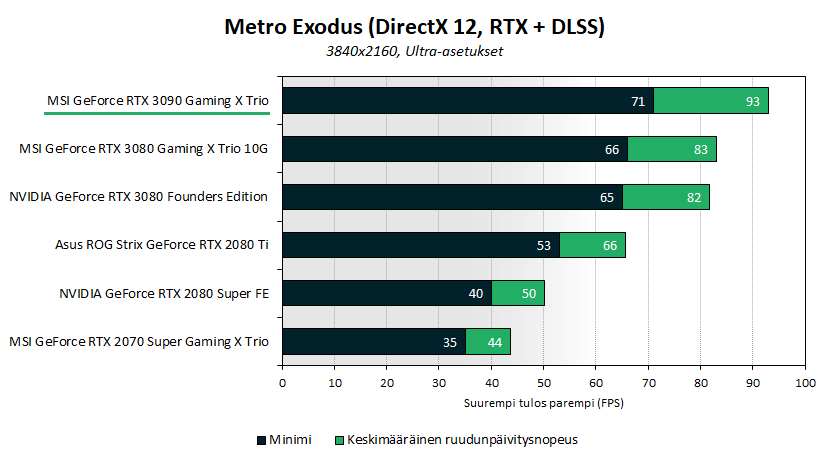

Metro Exoduksessa RTX-säteenseuranta ja DLSS päällä 4k-resoluutiolla MSI:n GeForce RTX 3090 oli 12 % suorituskykyisempi kuin MSI:n 3080 ja 41 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

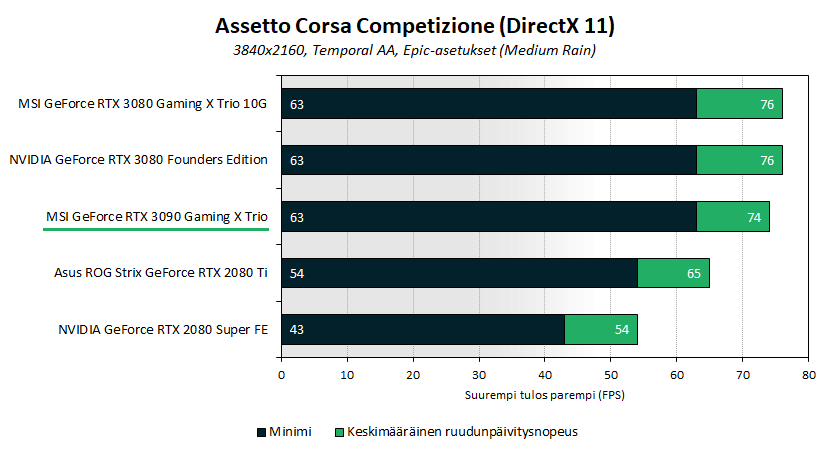

Testasimme pikaisesti Assetto Corsa Competitizone -peliä 4k-resoluutiolla, Epic-kuvanlaatuasetuksilla ja Medium Rain -sadeasetuksella. 29 kanssakilpailijalla GeForce RTX 3080 oli vielä 17 % suorituskykyisempi kuin 2080 Ti, mutta 3090:llä ruudunpäivitysnopeus ei enää parantunut, vaan pullonkaula on jossain muualla.

Suorituskykytestit 2560×1440-resoluutiolla

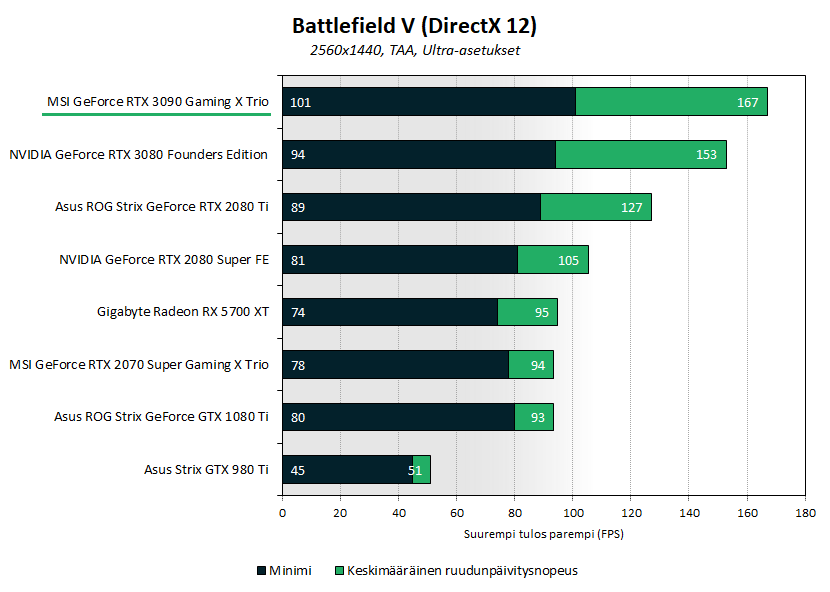

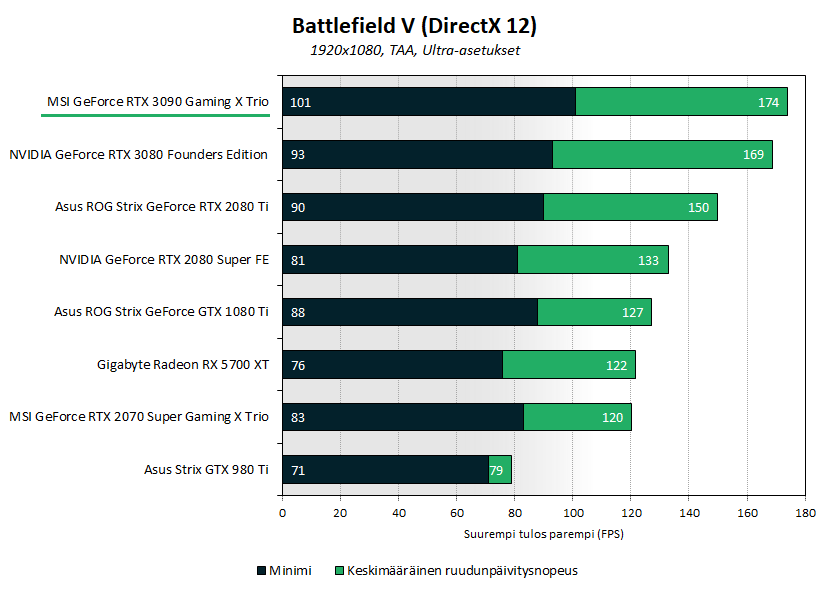

Battlefield V:ssä 1440p-resoluutiolla MSI:n GeForce RTX 3090 oli 9 % suorituskykyisempi kuin NVIDIAn 3080 Founders Editionilla ja 31 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

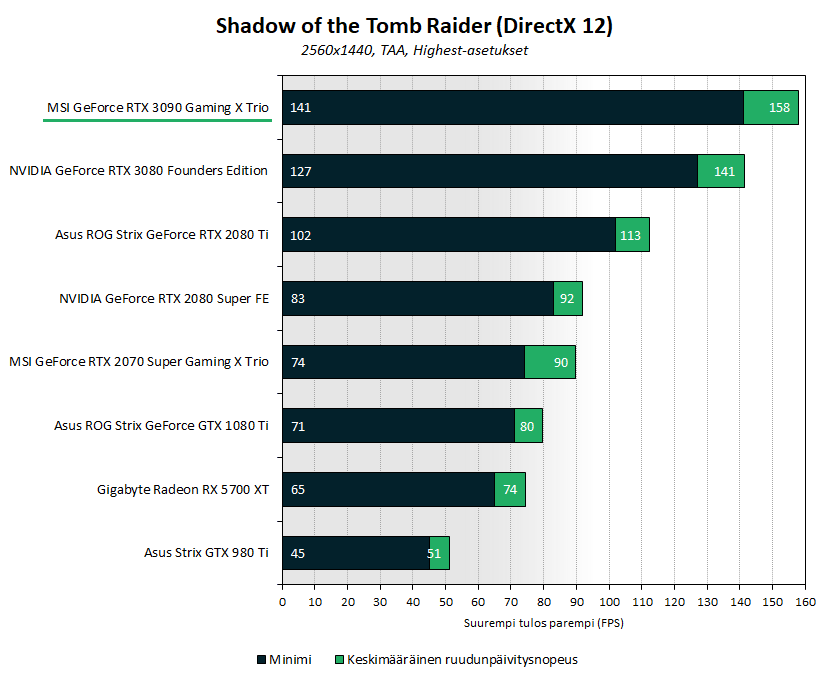

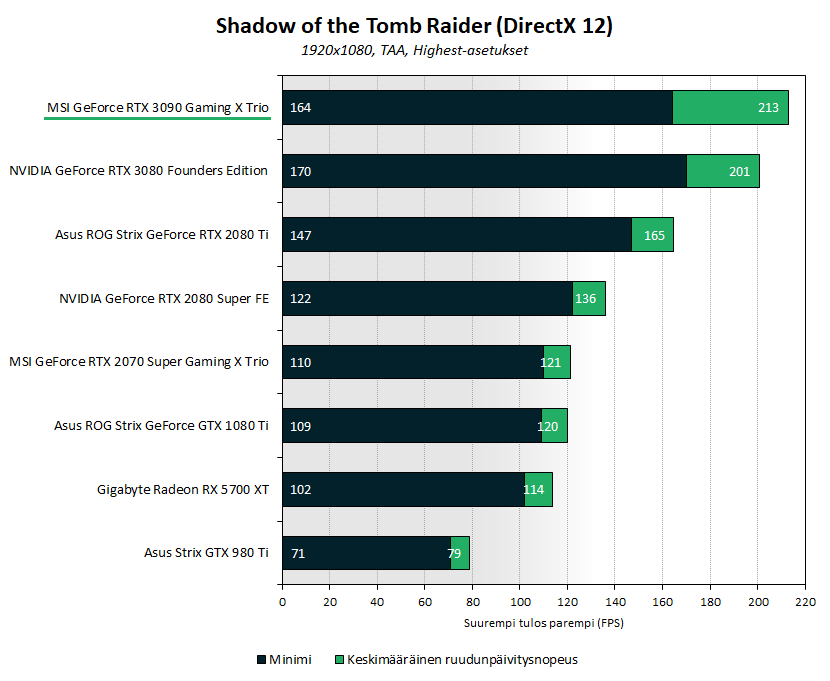

Tomb Raiderissa 1440p-resoluutiolla MSI:n GeForce RTX 3090 oli 6 % suorituskykyisempi kuin NVIDIAn 3080 Founders Edition ja 23 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

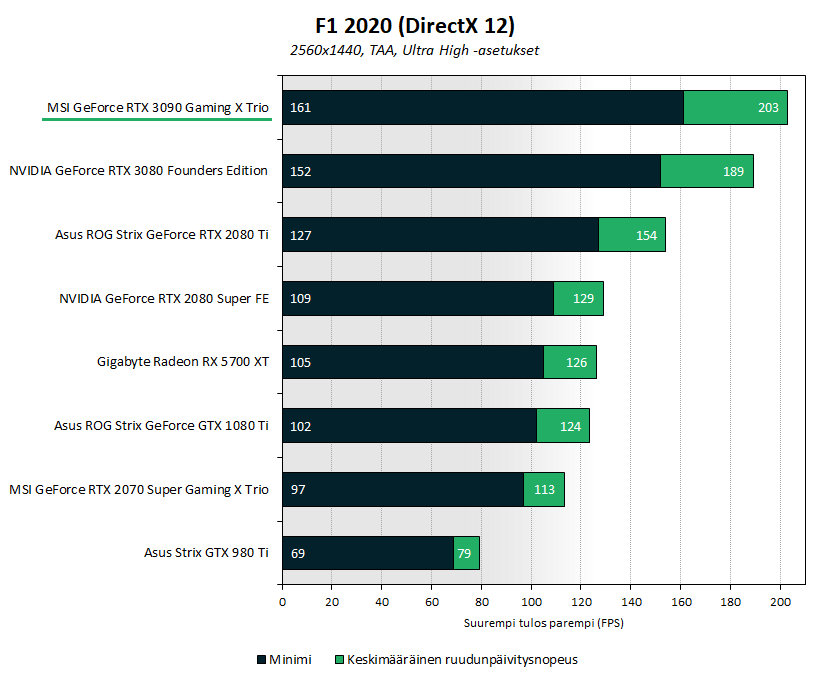

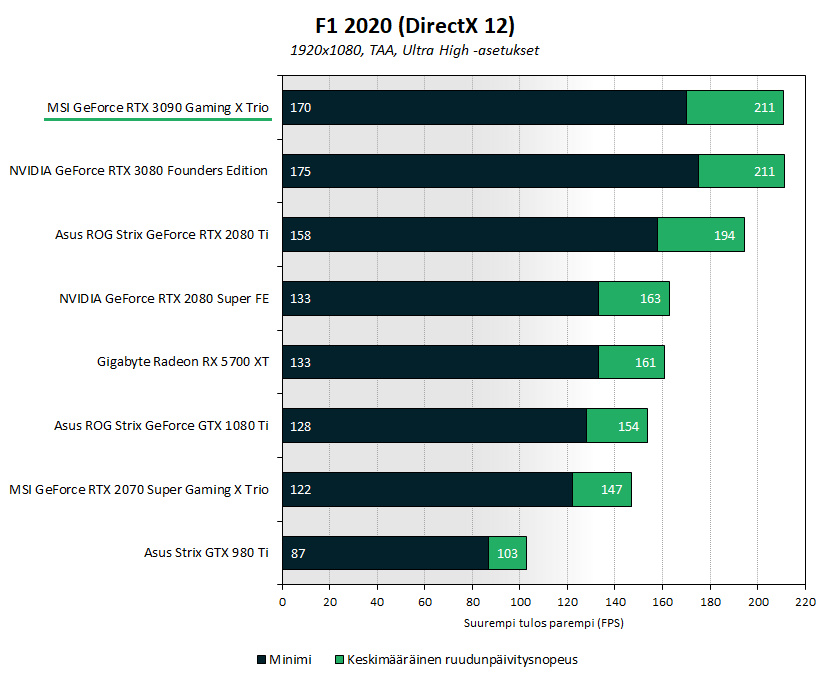

F1 2020:ssä 1440p-resoluutiolla MSI:n GeForce RTX 3090 oli 7 % suorituskykyisempi kuin NVIDIAn 3080 Founders Editionilla ja 32 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

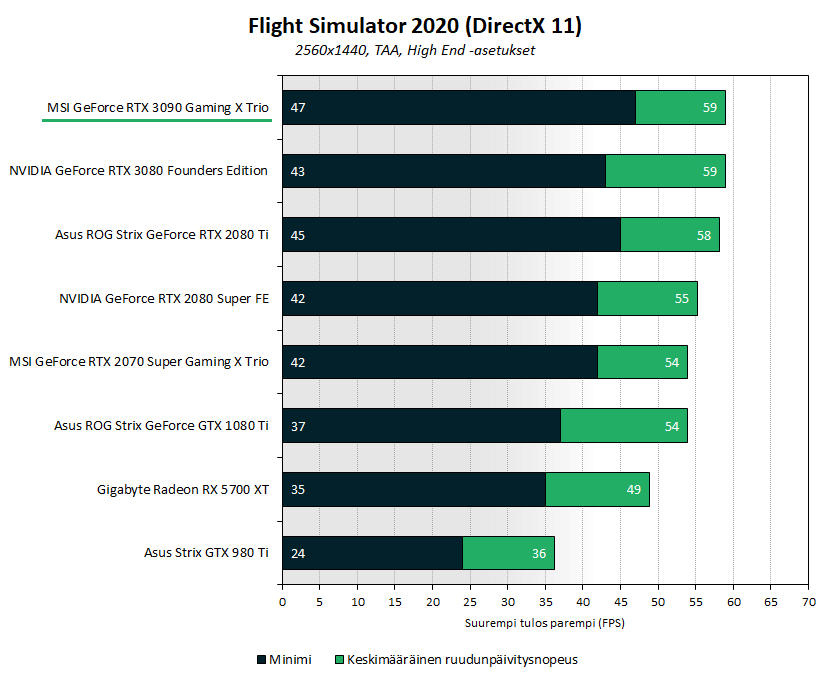

Flight Simulator 2020:ssä 1440p-resoluutiolla MSI:n GeForce RTX 3090:n keskimääräinen ruudunpäivitynopeus oli sama, mutta minimi 9 korkeampi kuin NVIDIAn 3080 Founders Editionilla ja keskimääräinen ruudunpäivitynopeus 1 FPS:n parempi kuin Asuksen Strix 2080 Ti:llä.

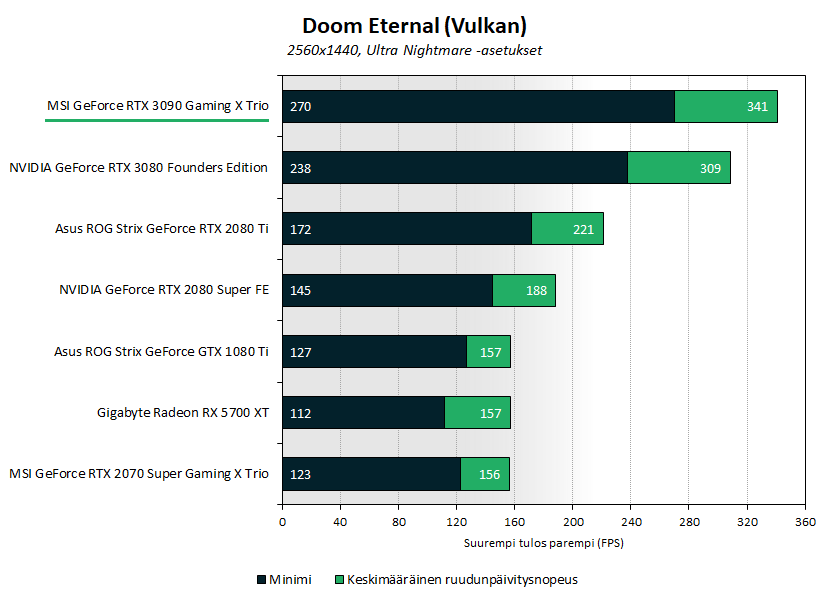

Doom Eternalissa 1440p-resoluutiolla MSI:n GeForce RTX 3090 oli 10 % suorituskykyisempi kuin NVIDIAn 3080 Founders Editionilla ja 54 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

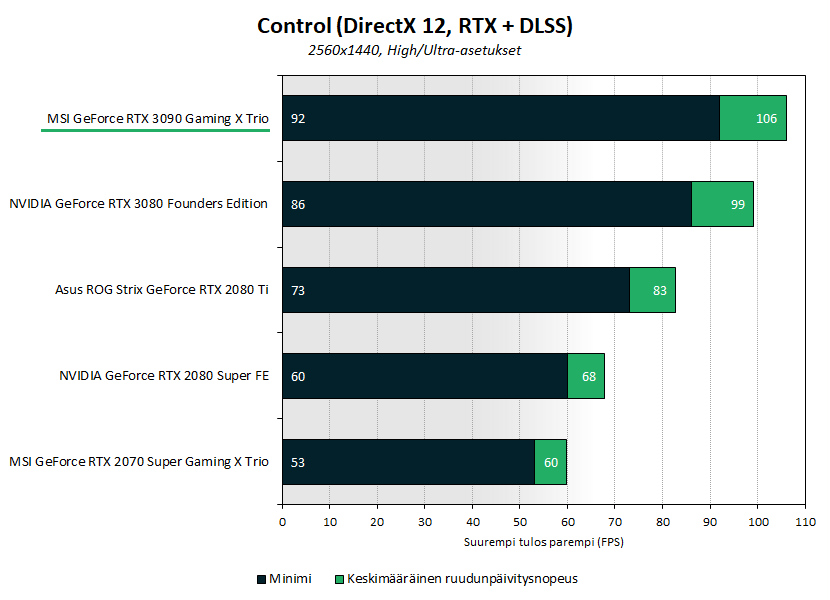

Controlissa RTX-säteenseuranta ja DLSS päällä 1440p-resoluutiolla MSI:n GeForce RTX 3090 oli 7 % suorituskykyisempi kuin NVIDIAn 3080 Founders Editionilla ja 28 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

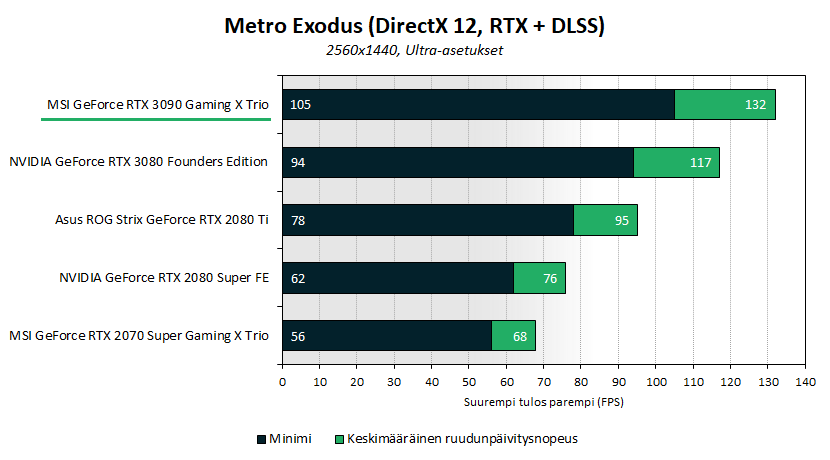

Metro Exoduksessa RTX-säteenseuranta ja DLSS päällä 1440p-resoluutiolla MSI:n GeForce RTX 3090 oli 13 % suorituskykyisempi kuin NVIDIAn 3080 Founders Editionilla ja 39 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

Suorituskykytestit 1920×1080-resoluutiolla

Battlefield V:ssä 1080p-resoluutiolla MSI:n GeForce RTX 3090 oli 3 % suorituskykyisempi kuin NVIDIAn 3080 Founders Editionilla ja 16 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

Tomb Raiderissa 1080p-resoluutiolla MSI:n GeForce RTX 3090 oli 6 % suorituskykyisempi kuin NVIDIAn 3080 Founders Editionilla ja 29 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

F1 2020:ssä 1080p-resoluutiolla MSI:n GeForce RTX 3090 oli tasoissa NVIDIAn 3080 Founders Editionin kanssa ja 9 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

Flight Simulator 2020:ssä 1080p-resoluutiolla MSI:n GeForce RTX 3090 oli tasoissa NVIDIAn 3080 Founders Editionin kanssa ja minimi oli 12 % korkeampi ja keskimääräinen ruudunpäivitysnopeus 1 FPS:n parempi kuin Asuksen Strix 2080 T:llä.

Doom Eternalissa 1080p-resoluutiolla MSI:n GeForce RTX 3090 oli 7 % suorituskykyisempi kuin NVIDIAn 3080 Founders Editionilla ja 36 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

Controlissa RTX-säteenseuranta ja DLSS päällä 1080p-resoluutiolla MSI:n GeForce RTX 3090 hävisi 1 FPS:llä NVIDIAn 3080 Founders Editionille, mutta oli sentään 2 FPS:ää suorituskykyisempi kuin Asuksen Strix 2080 Ti.

Metro Exoduksessa RTX-säteenseuranta päällä 1080p-resoluutiolla MSI:n GeForce RTX 3090 oli 6 % suorituskykyisempi kuin NVIDIAn 3080 Founders Editionilla ja 31 % suorituskykyisempi kuin Asuksen Strix 2080 Ti.

Hyötyohjelmat ja Open CL -suorituskyky

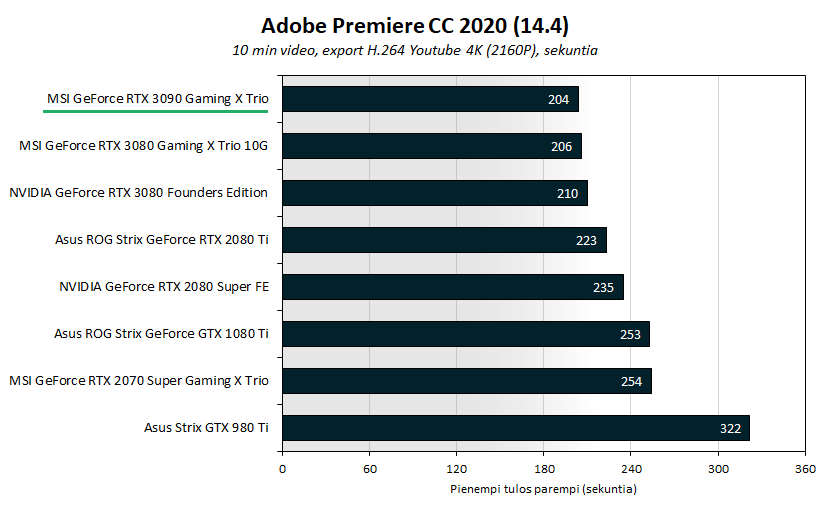

Adobe Premieressä 3090 oli 10 minuutin 4k-videon renderöinnissä 2 sekuntia nopeampi kuin 3080 ja 19 sekuntia nopeampi kuin 2080 Ti.

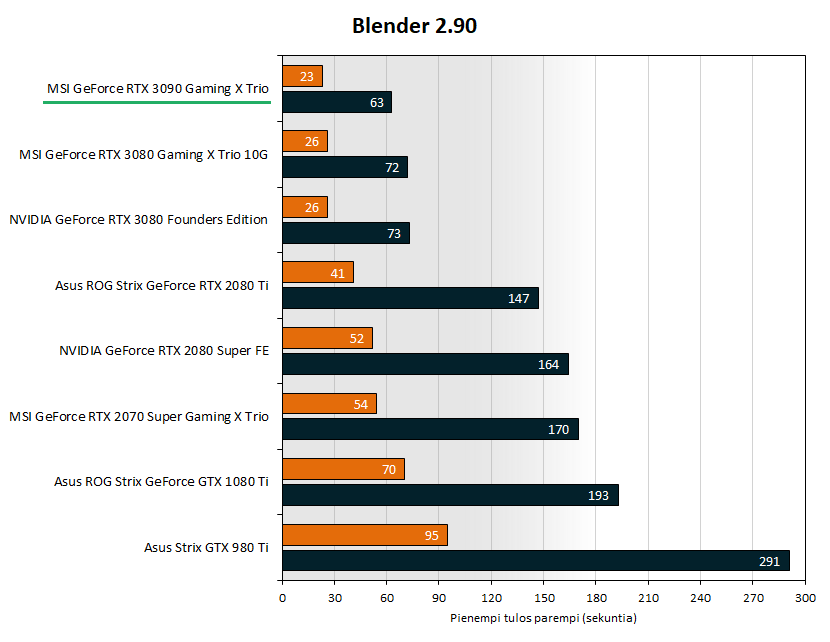

Blenderin BMW Benchmarkissa 3090:n aika oli 3 sekuntia eli 12 % nopeampi kuin 3080:llä ja 18 sekuntia eli 44 % nopeampi kuin 2080 Ti:llä.

Classroom-testissä 3090:n aika oli 9 sekuntia eli 13 % nopeampi kuin 3080:llä ja 84 sekuntia eli 57 % nopeampi kuin 2080 Ti:llä.

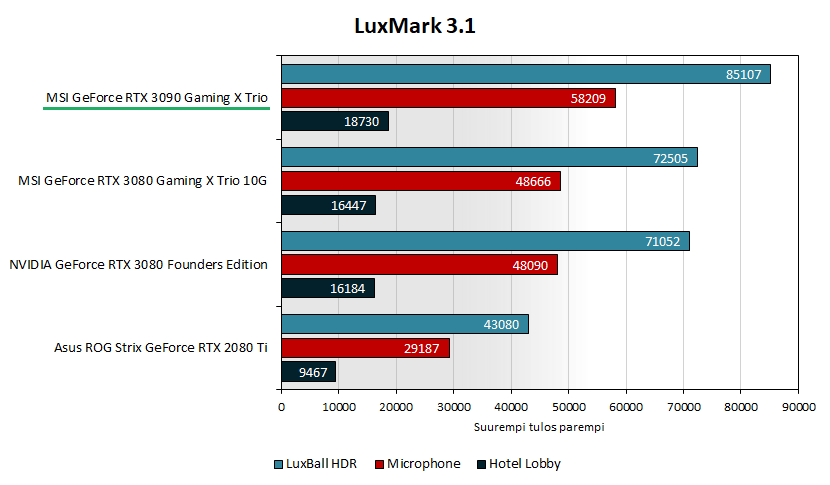

LuxMark 3.1:n testeissä 3090:n tulos oli 14-20 % parempi kuin 3080:llä ja 98-99 % parempi kuin 2080 Ti:llä.

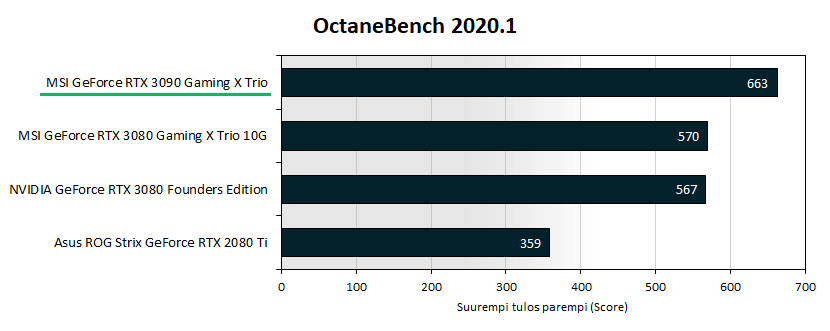

OctaneBench 2020:ssä 3090:n tulos oli 16 % parempi kuin 3080:llä ja 85 % parempi kuin 2080 Ti:llä.

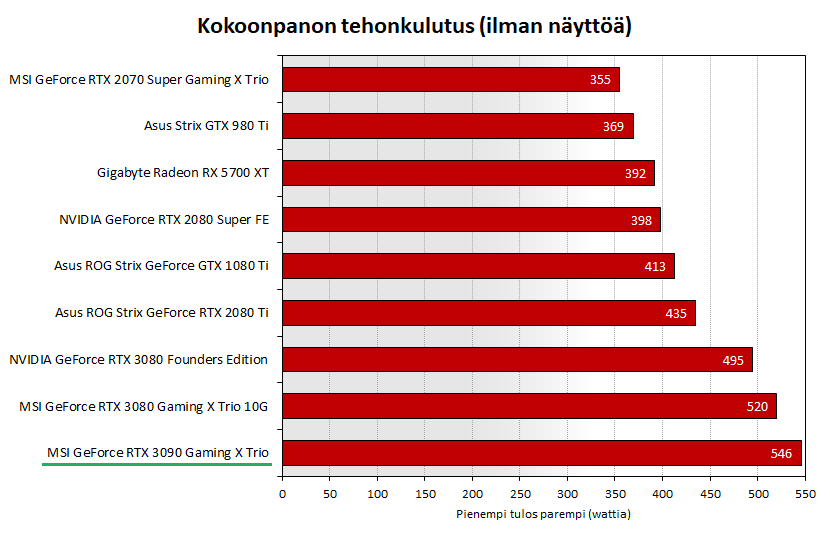

Tehonkulutusmittaukset

Tehonkulutusta mitattiin seinästä Etech PM-300 -mittarilla, joka kertoo koko kokoonpanon tehonkulutuksen ilman näyttöä. 3D-rasituksena käytettiin Battlefield V -peliä.

MSI:n GeForce RTX 3090:llä kokoonpanon tehonkulutus oli 26 wattia korkeampi kuin MSI:n 3080:llä ja yli 100 wattia korkeampi kuin 2080 Ti:llä.

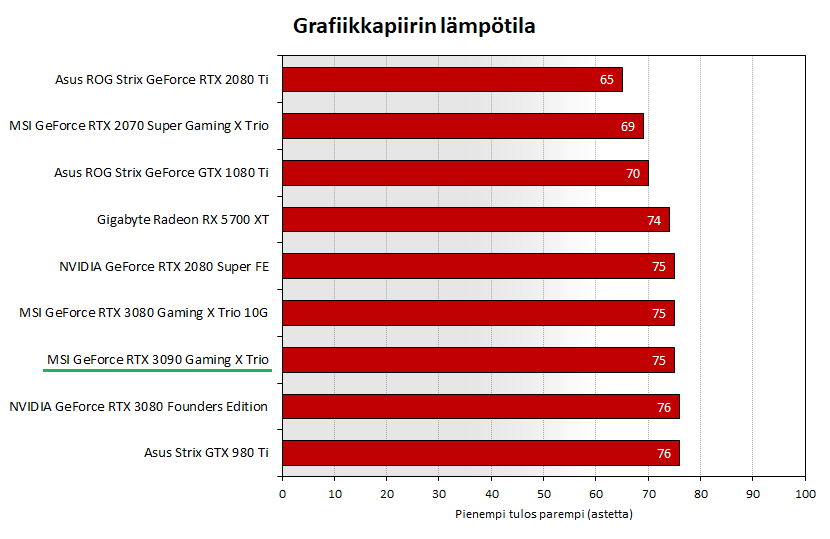

Lämpötilamittaukset

Grafiikkapiirin lämpötila mitattiin GPU-Z-ohjelman avulla ja 3D-rasituksena käytettiin Battlefield V -peliä.

MSI:n GeForce RTX 3090 Gaming X Triolla grafiikkapiiri toimi 75-asteisena, kuten yhtiön 3080-mallilla. Asuksen TUF Gaming 3090:llä grafiikkapiirin lämpötila oli 63 astetta ja Gigabyten 3090 Gaming OC:lla 64 astetta. Lisää näytönohjainvalmistajien välisistä eroista voi lukea io-techin 3090-custom-mallien vertailuartikkelista.

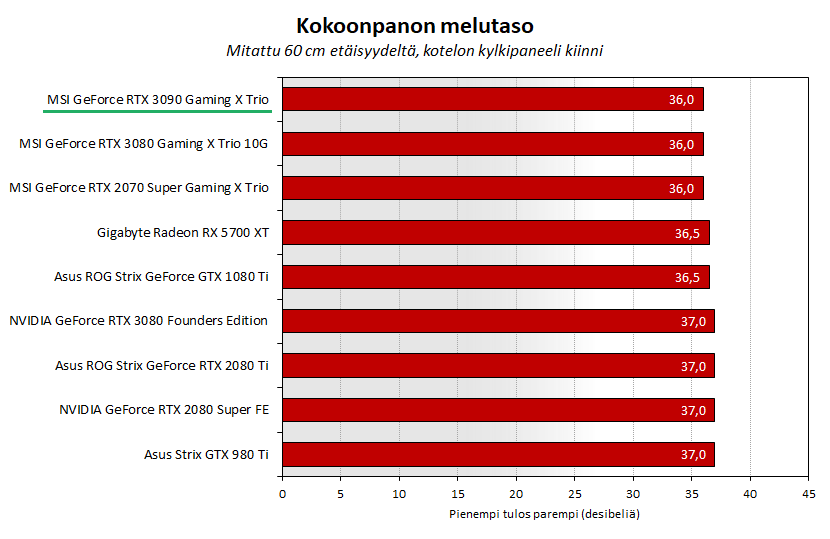

Melumittaukset

A-painotuksella suoritetuissa melumittauksissa Velleman DVM805 -desibelimittari sijoitettiin 60 senttimetrin päähän kiinni olevan kotelon kyljestä. Ympäristön melutaso testikokoonpano pois päältä oli 33,3 desibeliä. 3D-rasituksena käytettiin Battlefield V -peliä. Virallisesti melua mitataan tiettyjen standardien mukaan, joten mittaukset ovat lähinnä suuntaa antavia.

MSI:n 3090 Gaming X Trio oli yhdessä yhtiön 3080-mallin kanssa 3D-rasituksessa lähes äänetön 36 desibelin melutasolla. Asuksen TUF Gaming 3090:llä melutaso oli hiljainen 37,5 desibeliä ja Gigabyten 3090 Gaming OC:lla hieman äänekäs 39 desibeliä. Lisää näytönohjainvalmistajien välisistä eroista voi lukea io-techin 3090-custom-mallien vertailuartikkelista.

Korvakuulolla kaikilla testaamillamme 3090-malleilla oli kuultavissa 3D-rasituksessa jopa alhaisilla ruudunpäivitysnopeuksilla vaimeaa korkeataajuista sirinää. Pelejä ladatessa kaikki testaamamme 3080- ja 3090-mallit pitivät matalataajuisempaa sirkutusta.

Ylikellotustestit

Ylikellotustestissä MSI:n GeForce RTX 3090 Gaming X Trio oli asennettuna suljetun Cooler Master Cosmos C700P -kotelon sisälle. Power- ja Temp Target- eli tehonkulutuksen ja lämpötilan ylärajat nostettiin maksimiin eli 102 %:iin ja 91 asteeseen. Tuulettimen kierrosnopeuden annettiin olla lämpötilan mukaan automaattisesti säätyvässä Auto-asennossa. Saavutetut kellotaajuudet ovat suuntaa antavia.

MSI:n 3090 Gaming X Trion Power Limit on vakiona 370 wattia ja 2% korotus maksimiin tarkoittaa 380 wattia.

Näytönohjain ylikellottui GA102-grafiikkapiirin osalta +50 MHz eli 1835 MHz:n Boost-taajuudelle, jolloin todellinen kellotaajuus 3D-rasituksessa oli keskimäärin noin 1870 MHz. GDDR6X-muistit venyivät vakaasti ilman ongelmia +500 MHz eli 20,5 Gbps:n nopeudelle.

Grafiikkapiirin lämpötila nousi ylikellotettuna yhdellä asteella 76 asteeseen ja kokoonpanon tehonkulutus 546watista 555 wattiin. Tuulettimien kierrosnopeus pysyi samana eli 49 %:ssa ja 1475 RPM:ssä, kuten myös melotasu 36 desibelissä.

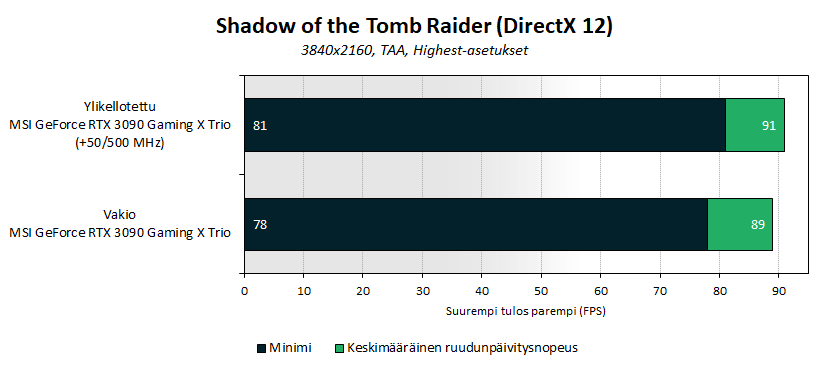

Ylikellotettuna MSI:n 3090 Gaming X Trion oli Tomb Raiderissa 4k-resoluutiolla vain noin 2 % suorituskykyisempi kuin vakiona.

Loppuyhteenveto

GeForce RTX 3090 osoittautui testeissä suorituskykynsä osalta hintaansa nähden pettymykseksi ja se tarjosi 4k-resoluutiolla 3080:een verratuna vain keskimäärin 11 % parannuksen pelisuorituskykyyn. Hyötyohjelmissa, kuten LuxMark 3.1:n testeissä 3090:n tulos oli 14-20 % parempi kuin 3080:llä. Alhaisemmilla 1440p- ja 1080p-resoluutioilla ero kaventui alle 10 %:iin.

Edellisen sukupolven vastaavasti hinnoiteltuun GeForce RTX 2080 Ti:hin verrattuna 3090 oli 4k-resoluutiolla pelitesteissä keskimäärin 47 %. Hyötyohjelmissa, kuten Blenderissä ja LuxMarkissa nähtiin yli 50 % ja jopa 100 % eroja.

GeForce RTX 3090:n testitulokset ovat loppujen lopuksi kuitenkin odotetunlaiset, sillä 20 % enemmän CUDA-ytimiä ja muistiväylän kaistanleveyttä ennakoivat noin 20 % teoreettista parannusta suorituskykyyn. Ainoa konkreettinen hyöty 3090:stä on merkittävästi suurempi 24 gigatavun näyttömuisti, josta saattaa olla hyötyä sekä teoriassa tulevaisuudessa muutaman vuoden päästä 4k-resoluutiolla korkeimmilla kuvanlaatuasetuksilla.

Hintatietoisen pelaajan on syytä unohtaa 3090 ja ostaa erittäin hyvää suorituskykyä reilun 730 euron hinnalla tarjoava 3080 ja säästää rahat, joko parempaan prosessoriin, isompaan näyttöön tai seuraavan sukupolven näytönohjainpäivitykseen.

Artikkeli päivittyy.

ei ole vielä strix oc top 1935mhz–boxista tullut ulos

ei evga ftw 3080 ole tullut boxista–ultra versio

ja vielä zotac amp extreme ja galax hof……

msi lightning?

Työasema kortti joka on markkinoitu 8K pelikortiksi, missä se saa ihanat 30fps tulokset. Täydellinen konsoli kokemus.

Toivottavasti tämän saa täällä mainita kuitenkin kun aika oleellinen kommentti on tähän testiin liittyen..

Siksi testaamme myös 10900K:lla, kute. 3 viestiä yläpuolella lukee.

Pahoittelut, en kerinnyt lukea kommentteja läpi vaan kävin suoraan kommentoimaan asiaa, kun huomasin että muualla oltiin jo testailtukkin noita rtx 3000 sarjalaisten eroja intelin ja amd:n välillä ja erot oli olleet huomattavat.

Toivottavasti testeissä on vertailu myös sitten näihin AMD:llä saatuihin tuloksiin myös eikä pelkästään vertailua eri näyttisten välillä 10900K:llä.

Ei ainakaan HardwareUnboxedin videossa saatu sen suurempia eroja Intelin ja AMD:n välillä 1080p resolla. 4K resolla taas ero Intelin ja AMD:n välillä oli pyöreä nolla.

Mitä taas tulee tähän markkinoituun "8K" pelaamiseen, niin on kyllä aika paksua Nvidialta väittää että kortti kykenisi moiseen. Toivottavasti AMD ei ensi kuussa sorru samaan höperehtimiseen. Siinä vaiheessa kun silloinen high end näytönohjain ei ole enää 4K resolla pullonkaula, voidaan alkaa ihan järjellä miettiä 8K pelaamista, ei ennen.

Kyllä niitä eroja löytyy, ihan todella selkeitä, mutta jos haluat jatkaa tästä juttelua niin tuolla Intel vs amd ketjussa jatkan mielelläni.

Ja kyllähän tuo "8K" itsestä ainakin vaikuttaa hyvin hienolta tuolla Nvidian kokoajan paremmaksi hiotulla tekniikalla. Ja hyvin innoissaan on ollut myös moni muukin.

Monikos peli edes tukee AMD:n "8K"-teknologiaa? Nvidialla niitä sentään on

Tässä vähän varmaan näkyy konsolien markkinointi kanssa, siellähän perinteisesti on puhuttu vuosikausia 4k pelaamisesta vaikka renderöintiresoluutio on ollut dynaamisen resoluution myötä mitä sattuu ja 30fps standardi. Nyt uudet konsolit pystyy samaan mutta ilman dynaamista resoluutiotakin tietyissä tapauksissa, joten NVIDIA varmaan ajatteli palauttaa vähän PC-puolen "etumatkaa" puhumalla samoin ehdoin 8k pelaamisesta. Varsinkin kun sattuu olemaan se kilpailijan teknologia siellä konsolin sisällä.

Vähän laajempana huomiona alkaisi vähän haiskahtaa että GPU-puolellakin aletaan tasautua raa’assa suorituskyvyssä, kellot ei ole nyt noussut ja pelkästään rautaa pakkaamalla ei vaikuteta pääsevän tehokkaaseen suorituskykykasvuun. Toki Ampere on arkkitehtuurina erilainen kuin Turing että suora vertailu tällä tavalla ei sinänsä ole pitävä todiste tästä.

Mutta pointtina että jos energiatehokkalla prosessillakaan ja suurilla wateilla ei saada raakaa fps-lukua puskettua enää järkevästi ylöspäin, on aika siirtyä toisenlaiseen kehitykseen ja muistinopeuksien kehitys sekä dynaamiset huippulaatuiset skaalaukset joita molempia NVIDIA on puskenut vaikuttaisi ihan järkevältä suunnalta. Joka tapauksessa dynaaminen tai ei-natiivi resoluutio tullee olemaan jatkossa PC-puolellakin tie pilvilinna 4k 360fps pelailuun, epäilen että muuten sinne ei päästä.

Suorituskyky ei ole vain kellojen nostamista. "rautaa pakkaamalla" viittaat vissiinkin pienempiin valmistusprosesseihin. Uudet prosessit mahdollistaa enemmän transistoreja per mm² ja sitä kautta saman kokoisella piirillä enemmän laskentakapasiteettia. Ja kyllä, uusia prosesseja on tulossa eikä kehitys ole erityisemmin "tastaantunut". Kasvu on ehkä hidastunut, koska vaikeusaste nousee nousemistaan, mutta ei todellakaan pysähtynyt.

5 nm lithography process – WikiChip

en.wikichip.org

katso liitettä 451061

Ja Samsungin "8nm" on about 61.2 MTr. Nytkin olisi jo saatavilla reippaasti parempaa TSMC "7nm" prosessia ja piakkoin myös "6nm" ja "5nm" prosesseja. Samankokoiseen piiriin tulee siis parin vuoden päästä saamaan tuplasti laskentayksiköitä kuin nyt.

Toki Nvidia yrittää (yritti) kertoa että tuo laki on kuollut ja siksi 2xxx sarja maksoi niin paljon… CES 2019: Moore’s Law is dead, says Nvidia’s CEO

Ei se vielä kuollut laki ole, vaikka hieman kangertelua ja hidastelua onkin ollut. Pääidealtaan edelleen voimassa.

Ei vaan viittasin lähinnä cuda-ytimiin 3080 vs 3090. Suorituskykyä ei irtoa samassa suhteessa missä ytimiä on lisätty. Tämä ei sinänsä ole prosessin vika varmaankaan, vaan johtunee myös ihan vaan softan (eli tässä tapauksessa pelien) kyvyttömyydestä käyttää niitä ytimiä tehokkasti hyödyksi.

Eli tarkennuksena: nimenomaan pelisuorituskyvyssä on mielestäni nähtävissä tasaantumista. Katto ei varmasti ole saavutettu mutta ei näytä minun silmiini siltä että vain tekemällä isompia kortteja päästään kovin pitkälle enää.

Kiitos vuodatuksesta.

Jotkut pelaa 1440P:nä jotkut 8K:na. Tässä listaa 8K peleistä:

Crysis Remastered

Red Dead Redemption 2

Far Cry 4

Battlefield V?

Call of Duty Modern Warfare Remastered

Gears 5

Doom Eternal

Control DLSS

Apex Legends

Death Stranding DLSS

Enlisted DLSS

Forza Horizon 4

Rainbow Six Siege

Wolfenstein: Youngblood DLSS

World of Warcraft

Halo: Combat Evolved

Halo: Reach

"100% hitaampi" tarkoittaisi, että nopeus on 0. En itse ymmärtäisi lainkaan mitä tarkoittaa "133% hitaampi".

Classroom testissä se 0 sekuntia olisi nopein mahdollinen. Kuvaako sinusta parhaiten nopeuseroa tässä testissä (kuviteltu tilanne) jos kerrotaan että 3090 oli 90 % nopeampi vai että se oli 10 kertaa nopeampi? Sama asia.

90% nopeampi on melkein 2 kertaa nopeampi

Sanoin ja tarkoitin "nopeus on 0", en puhunut mitään sekunneista. "90% nopeampi" tarkoittaa samaa kuin "1,9x nopeus", ei "10x nopeus".

Näinhän se olisi jos puhuttaisiin fps eroista jolloin suurempi on parempi. Kun puhutaan esim. blenderista ja pienempi on parempi niin entä sitten?

Mutta jos puhutaan että 3090 oli 90% nopeampi kuin XXXX-näytönohjain niin se tarkoittaa 10 kertaa nopeampaa kun puhutaan esim. blenderista jossa pienempi on parempi. Prosentit on paskamaisia, siksi itse kertoisin tämän tuloksen toisella, paremman kuvan antavalla tavalla. Ja siksi otin otin tämän esille.

Jos lähdemme vaimon kanssa 100m kilpajuoksuun. Minä juoksen 100m 20 sekunnissa ja vaimoni 10 sekunnissa. Vaimoni on tällöin minua 100% nopeampi eli ja on juossut 2 kertaa nopeammin.

Vaimosi on juossut 2 kertaa nopeammin. Jos hänen suoritustaan verrataan sinun upeaan tulokseesi niin sanotaaan että on ollut 50% sinua nopeampi. Sinun tulos siis ajateltuna 0 -20 sekkaa on 0 – 100%. Mutta sinä olit 100% hitaampi kuin vaimosi . Sitä tarkoitin kun sanoin että prosentit on paskamaisia.

. Sitä tarkoitin kun sanoin että prosentit on paskamaisia.

Vertaa tätä 3090 artikkelin hyötyohjelmasuorituskykyyn. 57 % nopeampi on 147 sekunttia / 63 sekunttia. Oikein kyllä mutta antaa väärän kuvan jos ei ymmärrä prosentteja.

Ei, vaan 100% nopeampi. Lamanka taas olisi 50% vaimoaan hitaampi.

Nämä asiat ovat hyvin yksinkertaisia, älä nyt yritä tehdä niistä tarpeettoman monimutkaisia.

1500 € sai sekä loistavan 3000 nits 55" HDR näytön että loistavan 3000 nits 55" HDR TV:n. Minusta tämä ei ole mitenkään yliampuvaa.

Riippuen pelista, niin FPS voi olla niinkin alhainen kuin 20 FPS. Katson, että yleensä 30 FPS:ää riittää peleissä, joissa reaktioaika tarve on sekunneissa eikä millisekunneissa. Perinteisesti elokuvat on kuvattu 24 kuvaa sekunnissa, eikä niiden yhteydessä ole puhuttu slide showsta.

FPS peleissä 60 FPS:ää on mini, 120/144 FPS:ää toivottava ja 240 FPS:ää turha.

Antia-aliasing on turha kaikissa 8K peleisssä.

Kyllä, rajaan FPS pelit pelivalikoimani ulkopuolelle.

Minä se tykkään lennellä kahdella kaarevalla leveähköllä näytöllä (yhteensä 8K näytön verran pikseleitä) MS Flight Sim 2020 simulaattoria. Ei riitä siinä simussa edes 11gt muistia kaikille tekstuureille medium asetuksilla tämänhetkisellä kortilla, joten vaihtoehdot tulevaisuudessa sujuvaan lentelyyn ovat silloin RTX3090 tai RTX3090. Eli kyllä siinä pelaamisessakin muistilla on osansa, riippuen tietysti paljonkin näyttökalustosta. Intelin I9 9900K prossun saan nesteillä kellotettua 5ghz, joten pullonkaulat saanee siinä rikottua ja 3090 kortistakin paljonkin enemmän irti, kuin tämän testin tekijät. Nesteellä yleensäkin saa lisäksi näyttiksestä kuin näyttiksestä min. 10-20% ylikellotukset toimimaan ilman mitään isompia ongelmia. Aikasempia kommentteja lueskelin ja näin on, että joku rakentaa koko koneensa puolella toista tonnilla, jotkut toiset sitten maksavat pelaamisestaan huomattavasti enemmän. Rog Strix 3090 korttia odotellessa. Ps. Niin, ja jos ei kukaan ole vielä hokannut, voi 3090 kortteja ostaa 2 kpl (sitten kun yhden kortin ostobänni loppuu) ja laitaa SLI, niin alkaa 8K pelit pyöriä ihan uudella tavalla…

Ei taida kyllä millään kahdella näytöllä oikein saada 8K verran pikseleitä; 8K on neljä kertaa 4K resoluutio, eli noin 33 miljoonaa pikseliä.

Suurimmat ultrawidet lienee 5120×1440 ja 5120×2160, joilla kaksi näyttöä olisi ~15 miljoonaa ja ~22 miljoonaa pikseliä.

Ja SLI tuki on varsin rajoitettua jo nyt ja tuki tulee vain heikkenemään entisestään:

NVIDIA hautaa SLI-teknologian – io-tech.fi

http://www.io-tech.fi

Kahdella tällaisella saa enemmän pikseleitä kuin 8K-näytöllä on.

2x (6016 x 3384) = 40 716 288 pikseliä.

Pro Display XDR – Tekniset tiedot

http://www.apple.com

On noilla simulaattorimiehillä varaa laittaa rahaa harrastuksiinsa…

(Sitä vain ihmettelen, miten RTX 3090:ltä saa kuvan noiden näyttöjen Thunderbolt 3/USB-C -liittimille)

Kahdella tällaisella saa enemmän pikseleitä kuin 8K-näytöllä on.

2x (6016 x 3384) = 40 716 288 pikseliä.

Pro Display XDR – Tekniset tiedot

http://www.apple.com

On noilla simulaattorimiehillä varaa laittaa rahaa harrastuksiinsa…

(Sitä vain ihmettelen, miten RTX 3090:ltä saa kuvan noiden näyttöjen Thunderbolt 3/USB-C -liittimille)

Tulokset ilmaistaan prosenttilukuina siksi, että se kertoo suhteellisesta suorituskyvystä. Sen avulla on helpompi hahmottaa kahden näytönohjaimen tai prosessorin välistä eroa yleisellä tasolla.

Se että prosentit käyttäytyvät suurempi kuin tai nopeampi kuin tilanteissa erilaisesti ja niiden hahmottamisessa on vähän kaksiteräinen miekka, vaikeampi keksiä selkeämpää tapaa esittää erot.

Jos joku on 100% suorituskykyisempi niin tulos on kaksinkertainen, mutta 100% nopeampi tarkottaisi sitä, että tulos olisi 0, puolet on 50%.

Ehkä sen prosenttia nopeampi voisi kääntää prosenttia suorituskykyisemmäksi, tai kertoa että se toinen oli x prosenttia hitaampi? Silloin prosentit vastaisi sitä nopeuseroa mitä fps puolella tulee. .

.

Onneksi grafiikat kuitenkin kertoo enemmän kuin tuhat sanaa. Ja taidan olla ainut jota kiinnostaa niin jätetään tähän

Tuossa pelissä ei ole kyllä mitään muuta kuin pullonkaulaa ja on ihan sama onko 3080 tai 3090.

Nvlinkillä sitten tippuu suorituskyky tai ainakin vielä kuukausi sitten tippui.

Mutta onneksi ei haittaa kun ei kiinnosta kys.peli pätkääkään.

tähän otetaan…. alvit..alv 0..alv14%

Lukijan kannalta selkeintä olisi mielestäni ilmoittaa kaikissa tapauksissa suorituskyvyn ero.

Mitä "x % nopeampi" -sanontaan tulee, niin itselläni on kyllä ollut tapana käyttää sitä juuri nopeuksien eikä aikojen vertailemiseen, ja esimerkiksi urheilusuoritusten tapauksessa olen muuntanut ajat ja matkat nopeuksiksi (tai oikeammin vauhdeiksi) metreinä sekunnissa ennen vertailun tekemistä. "Nopea"-sanalla on toki sekä suureen nopeuteen että lyhyeen aikaan viittaava merkitys, joten asiayhteyden mukaan joutuu päättelemään tai jopa arvaamaan, kumpaa milloinkin tarkoitetaan. Tässä artikkelissa todettiinkin "ajan" olleen x % nopeampi laitteella A kuin B, joten asia tuli kyllä selväksi.